Stable Diffusion 3論文読み:ついにUNetを卒業したようです

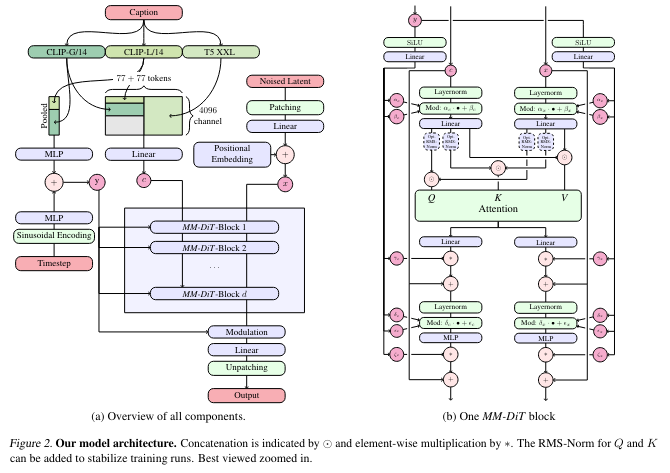

Stable Diffusion 3は、CLIPとT5を組み合わせた新しいText Encoderや、DiTアーキテクチャの導入で大幅に進化しました。新しいノイズスケジューラーにより、生成性能が向上し、txt2imgで最先端モデルを超える性能を実現。簡単に論文の内容を説明します。

Stable Diffusion 3は、CLIPとT5を組み合わせた新しいText Encoderや、DiTアーキテクチャの導入で大幅に進化しました。新しいノイズスケジューラーにより、生成性能が向上し、txt2imgで最先端モデルを超える性能を実現。簡単に論文の内容を説明します。

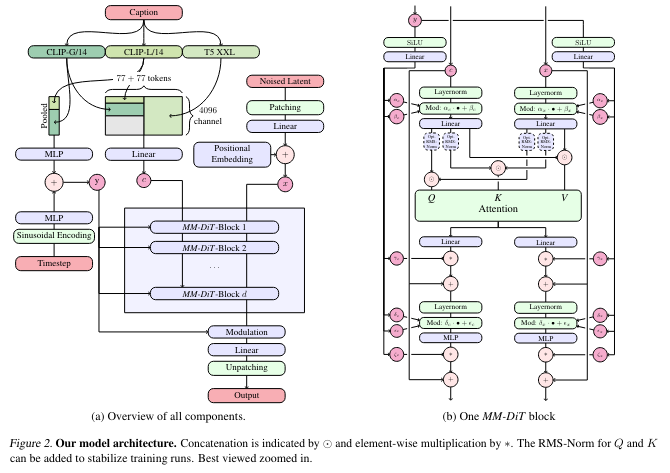

StabilityMatrixを利用してComfyUIをインストールし、設定する手順を詳しく解説。モデルの管理や実際の画像生成プロセスについても触れ、実際に試してみた感想とともに、利点と欠点を紹介します。

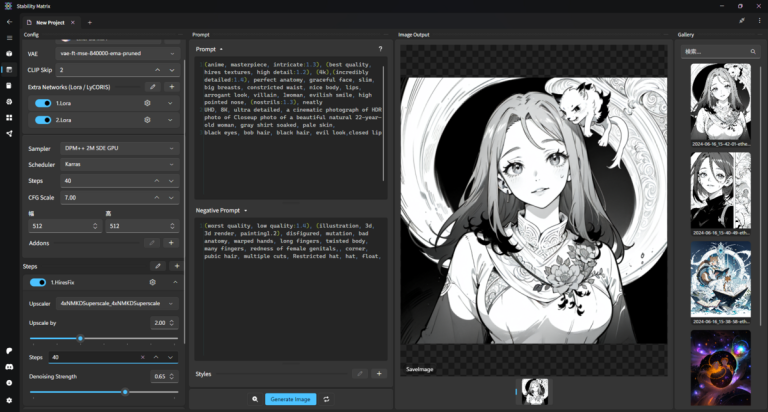

Stable Audio Openが無償公開され、ローカル環境で実行できるようになりました。この記事では、公式デモを実行するために必要な準備から具体的な実行方法までを解説します。

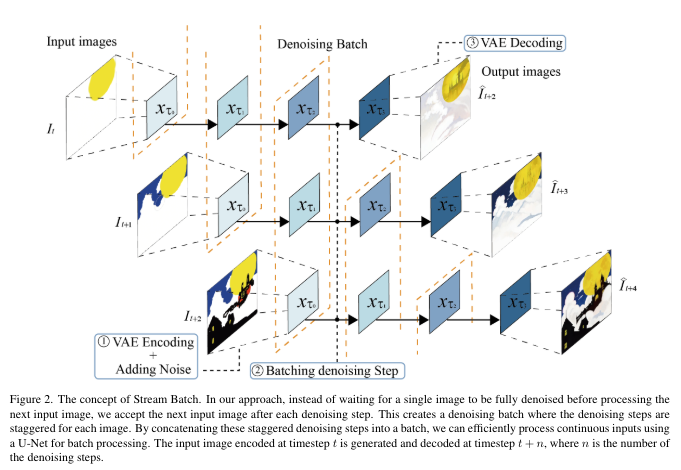

Stream Diffusionはリアルタイムで高品質な画像生成を可能にする技術です。この記事ではStream Diffusionがどのようにリアルタイムの画像生成を可能にしているのかを簡単に説明します。

この記事では、ComfyUIを使用し、ESRGANで画像をアップスケールする具体的な手順と生成結果を紹介します。

この記事では、ComfyUIを使って、Stable DiffusionのOutpaintを行う手順を紹介します。Outpaintを使用することで、自分で描かずとも、画像の外側に新しい内容を追加することができます。

ComfyUIを使ったStableDiffusionによるInpaint技術の手順を詳しく解説。画像の特定部分をマスクし、新たな要素を追加する方法をステップバイステップで説明します。生成結果も掲載しています。

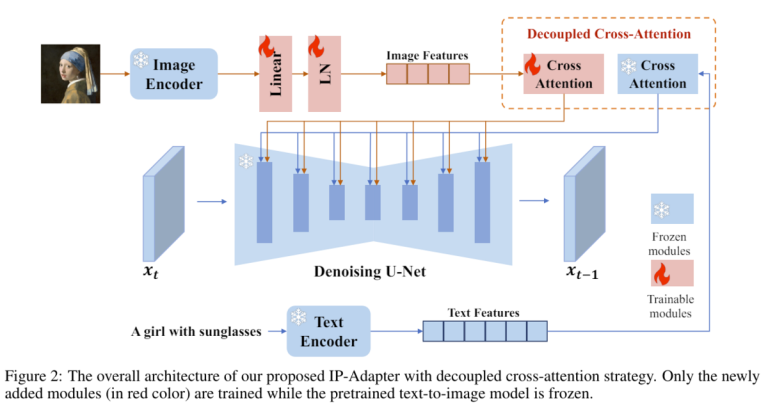

IPAdapterは、既存のStable Diffusionモデルに画像プロンプト機能を追加し、計算コストを抑えながらも画像のスタイルを維持した画像生成を実現します。この記事では、そのアーキテクチャやメリット、評価結果について簡潔に解説します。