Face DetailerはAIで画像生成する際のテクニックの一つであり、画像生成で崩れがちな顔部分だけを手直しすることができます。(顔をマスクしてinpaintしています)

この記事ではFace DetailerをComfyUIで簡単に試す方法を紹介します。

作業手順

1. ComfyUIの導入

ComfyUIを導入します。導入済の方もComfyUIを最新版にアップデートしてください。

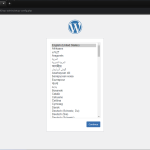

2. 拡張のインストール

以下の拡張をインストールします。

3. ワークフローをインポートする

以下のワークフローをインポートして使用します。デフォルトのワークフローを拡張して、生成後のフローにFaceDetailerを追加しています。

4. 生成する

プロンプトとモデルを調整して生成

生成結果

分かりやすいようにSD1.5の顔が崩れやすいモデルを使用しています。

最後に

今回はComfyUIでFaceDetailerを使用して、顔だけ生成し直す手法を紹介しました。

顔が崩れやすいと感じた場合にワークフローに組み込んでみるとうまく生成できるようになることが多いので、選択肢として持っておくと良いかと思います。自分の場合はSD1.5モデルを使う場合、AnimateDiffで動画を生成する場合に使用することが多いです。